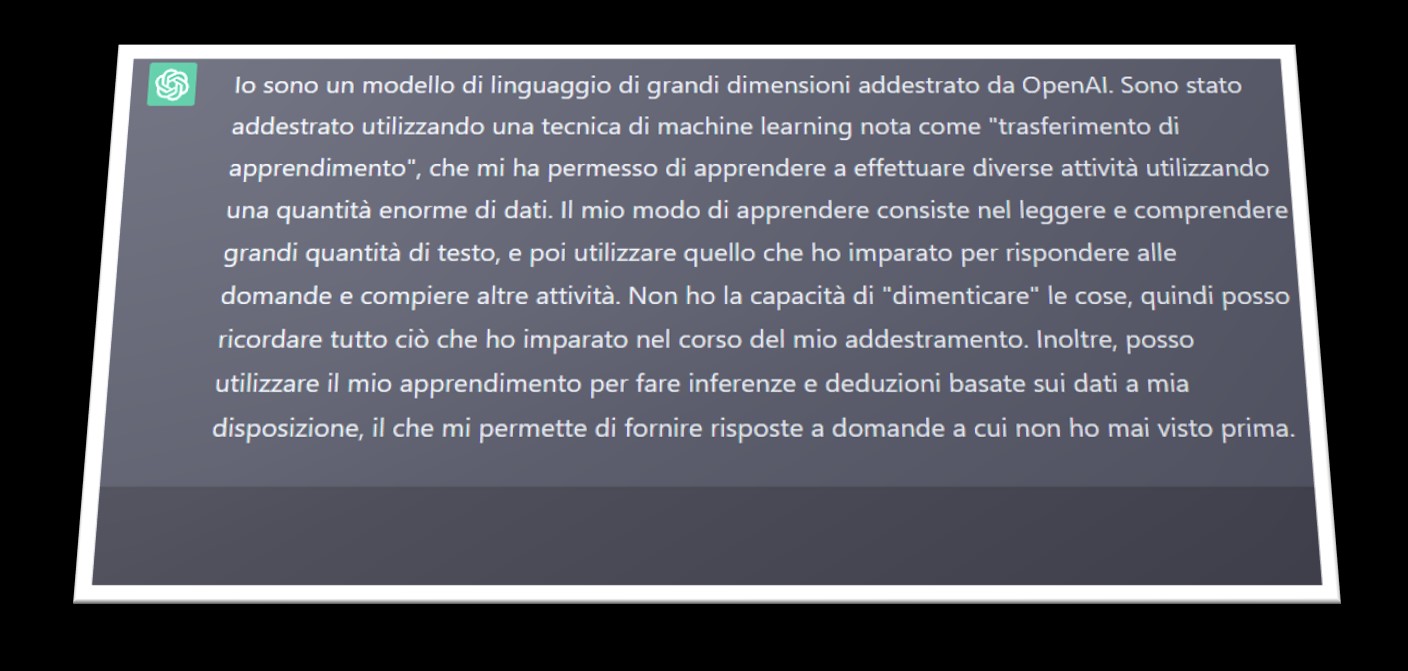

Si parla molto in questo periodo di ChatGPT, il motore di AI messo a disposizione per libero utilizzo da OpenAI. Per chi non lo conoscesse: OpenAI si occupa da anni dello sviluppo di Intelligenze Artificiali per diversi scopi. L’innovativa caratteristica di questo software è quella di riuscire a creare contenuti e correlare informazioni provenienti da una sconfinata libreria di testi, sulla base dei quali il motore è stato “addestrato” in modo da renderlo in grado di produrre risposte del tutto indistinguibili da quelle di un essere umano.

Cosa può fare ChatGPT

Dove un motore come Google si limita a fornirvi i risultati che ritiene più pertinenti cercando su Internet, ChatGPT è in grado di darvi una risposta completa, articolata e argomentata. Scrive testi, analisi, riassunti. Mette in correlazione filosofi, risolve problemi matematici, scrive script e programmi per poi modificarli in base a ogni vostro desiderio.

L’incomprensione che circonda questa tecnologia

Quello su cui mi voglio soffermare è l’enorme incomprensione che secondo me circonda questa tecnologia. Leggo articoli anche su eminenti quotidiani relativi al fatto che la nuova AI non sa la matematica o fornisce risposte palesemente sbagliate. Premesso che i creatori del motore hanno ben spiegato che gli errori sono possibili… mi chiedo perché nessuno si fermi a riflettere sul perché tali errori siano possibili.

L’aspettativa comune sembra essere quella di confrontare questo motore con un Oracolo perfetto, in grado di dare risposte sempre corrette. Eppure non ci si rende conto che sta in queste risposte erronee, secondo me, il suo avvicinamento ad avere un’intelligenza. ChatGPT crea risposte in base a quello che ha appreso e a quello che ha interpretato, esattamente come faremmo noi. Vuol dire che è perfetto? Assolutamente no. Vuol dire solo che si avvicina all’Intelligenza definita come capacità di apprendere, ricordare, correlare e utilizzare informazioni.

Pensiero critico: la vera frontiera

Quello che vorremmo da questa tecnologia sono risposte affidabili e corrette. Per ottenerle, come chiederemmo a qualsiasi essere umano scrupoloso, vorremmo l’applicazione di un pensiero critico: la capacità di verificare un risultato in base ad altre fonti ritenute affidabili, producendo un risultato finale comprovato e argomentato. Questo ancora manca — ed è per questo che aziende come Google che hanno già creato AI simili (si veda il progetto LaMDA) erano ancora lontane dal mettere sul mercato i loro prodotti: non si possono permettere di fornire strumenti che darebbero risultati a volte palesemente sbagliati ai loro clienti.

In questo vedo però una doppia contraddizione. Da una parte noi consumatori abbiamo aspettative sbagliate: un’AI può sbagliare esattamente come sbaglierebbe qualsiasi intelligenza evoluta. Non è grave — basta capire il suo errore e insegnargli esattamente come faremmo con un collega. Dall’altra, queste aziende sembrano restie a commercializzare strumenti fallibili che hanno già oggi un’utilità incredibile, a patto che chi li usa abbia chiaro che almeno finché non miglioreranno ulteriormente, andranno utilizzati per quello che sono: strumenti che riducono enormemente il lavoro al prezzo di qualche verifica.

La mia esperienza pratica

Ho provato a usare ChatGPT nell’ultimo mese per ricerche e analisi di diverso tipo. Mi sono accorto che dà risposte diverse in base a come gli vengono poste le domande, ma non solo: in base al nostro riscontro si corregge e modifica le proprie risposte. La fallibilità e l’imprecisione quindi fanno parte della sua natura — ed è proprio questo il bello, a patto che possiamo migliorarlo e che i risultati di quel miglioramento ci vengano riconosciuti.

Ho provato a fargli scrivere script di diverso genere per le mie necessità, chiedendo correzioni e integrazioni sempre in linguaggio naturale, ottenendo alla fine sempre un buon risultato. Perfetto? No. Da controllare? Sì. Ma delle buone bozze da cui partire che mi hanno fatto risparmiare un bel po’ di tempo.

Come per qualsiasi strumento, la prima cosa da avere sempre ben chiara è dove sono e quali sono i suoi limiti. Chiariti questi, lo si può utilizzare in modo ragionato e responsabile ottenendone solo vantaggi.

Leave a Reply

You must be logged in to post a comment.